AIトークンのコストが組み込み型分析ツール:なぜCIOの問題になりつつあるのか

AIトークンコストは現在、特にAI搭載の組み込み分析を出荷するSaaSチームにとって、CIOの予算の一部となっています。組み込み分析層内のすべての自然言語クエリ、生成されたダッシュボード、自動化されたインサイトは、大規模な言語モデルからトークンを書き込みます。数千人のユーザーを持つマルチテナントSaaSプラットフォームでは、その数は急速に増えます。AIトークン消費を管理するには、ガードレール、モデルの柔軟性、使用状況の監視など、真のガバナンスが必要です。Revealこれらのコントロールを初日からAI搭載の組み込み分析に組み込んでいるため、チームはコストが急増することなくAI分析をスケールできます。

エグゼクティブサマリー:

キー・テイクアウェイ:

- AIトークンコストは組み込み分析の金融アーキテクチャの懸念となっています:AI組み込み分析の普及が進むにつれて、トークンの使用はユーザー、テナント、ワークフローにまたがって増加しています。

- AI分析は「遅いBI」問題を解決しますが、コストプレッシャーも生じます。より速い回答には裏で多くのモデル操作が必要で、それぞれトークンが必要です。

- マルチテナントSaaSプラットフォームは組み込み分析によるトークン消費を増幅:テナントとユーザーの各インタラクションがLLMトークン利用の増加に寄与しています。

- 責任あるAI分析にはガバナンスメカニズムが必要です。ガードレール、監視、モデルの柔軟性がAIトークンコストの管理に役立ちます。

- AIトークン最適化はアーキテクチャの決定に依存します。モデルの選択、リクエスト制限、利用の可視性が支出に直接影響します。

- Revealのようなプラットフォームはコストガバナンスを組み込み、トークンガードレール、インフラ制御、安全な展開を支援します。SaaSチームはAI組み込み分析を責任を持って拡大できます。

SaaSリーダーの半数以上(57%)が、2026年の開発ワークフローにAIを統合することが最大の懸念事項だと答えています。その圧力はエンジニアリングチームをはるかに超えて広がっています。それはCFOのオフィス、CTOのロードマップ、そして今度はCIOの予算に届きました。

AIトークンコストは当初はエンジニアリング上の課題として始まりましたが、組み込み分析を備えたSaaS製品では、現在では経営陣の予算に到達しています。

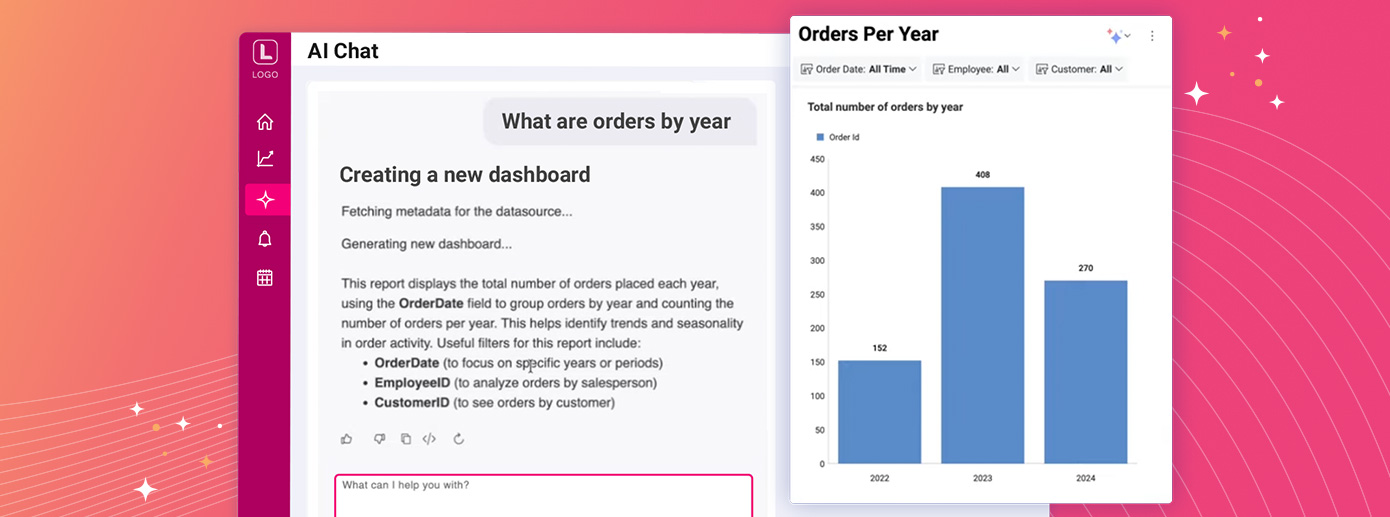

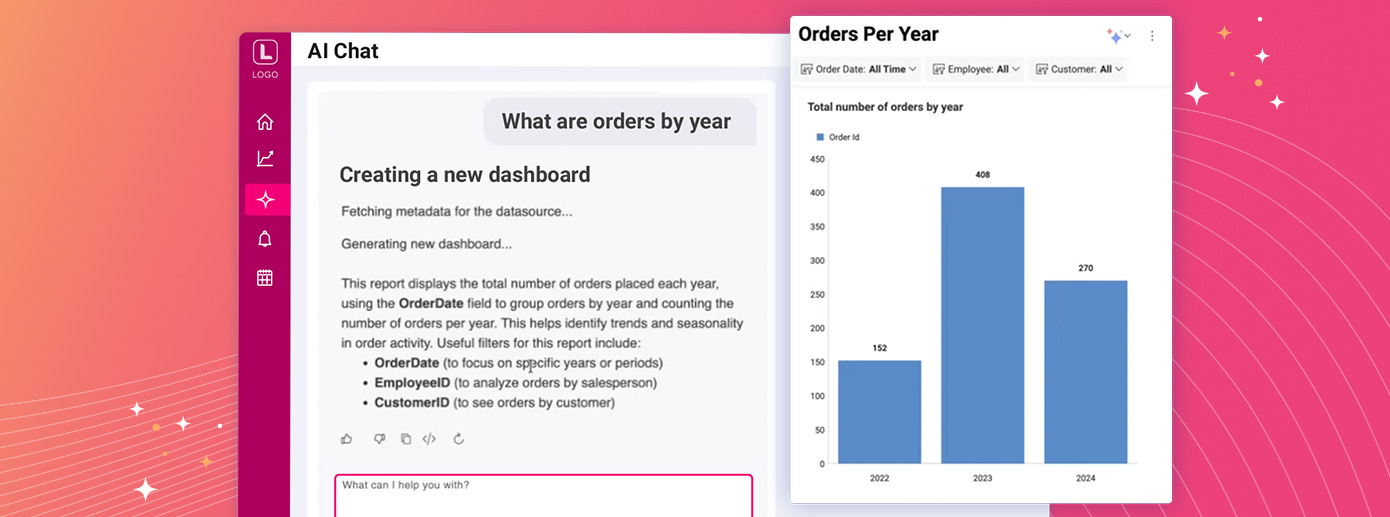

製品の分析層が、多くの負荷が現れる場所です。SaaS製品分析は、社内チームと外部顧客の両方をサポートします。AI搭載の組み込み分析により、クライアントはアプリ内で直接自然言語の質問をしながら、自分でダッシュボードやインサイトを探索できます。

各相互作用がモデル処理を引き起こします。質問、生成されたダッシュボード、自動化されたインサイトが、裏でLLMトークンの利用を生み出しています。

小規模では、その影響は小さく見えます。SaaSスケールでは、その影響は無視するのがはるかに難しくなります。

AI分析の隠れたコスト

ほとんどのAIとのやり取りはユーザーにはシンプルに見えます。ユーザーは質問をし、明確な答えを期待します。システムは数秒でインサイトを返します。そのシンプルさの裏にははるかに複雑なプロセスがあり、各ステップにトークンがかかります。

では、AIトークンのコストとは何でしょうか?簡単に言えば、AIトークンコストは大規模言語モデルがリクエストを処理する際に発生する計算使用量を表しています。各プロンプト、レスポンス、または中間ステップは、プロバイダーが料金を請求するトークンを消費します。組み込み分析ワークフローでは、モデルがデータを解釈し、クエリを生成し、洞察を生み出すことでこれらのトークンは急速に蓄積されます。

現代のAI分析システムは、回答を生成する前に構造を解釈しなければなりません。モデルは複数のデータソースにわたるスキーマ、関係性、メタデータを分析することが多いです。

その準備作業は隠れた作業量を増やす。すべての工程でモデル処理が必要です。その結果、多くのチームが予想するよりも多くのLLMトークン使用率が高まります。

典型的なSaaS分析のリクエストを考えてみましょう。ユーザーは収益の傾向や解約シグナルを尋ねることがあります。一部のプラットフォームは、単純な質問からAI生成の完全なダッシュボードを作成できる場合もあります。プラットフォームは結果を表示する前に複数のタスクを実行しなければなりません。これらのタスクはダッシュボードが表示されるずっと前からトークンを消費します。

これらの各ステップはトークンを消費します:

- スキーマ解釈

- 計量識別

- クエリ生成

- 可視化選択

- 洞察の要約

これらも追加のモデル処理を必要とします。利用が増えるにつれて、AIの1回の利用コストも増加します。時間が経つにつれて、そのパターンは明らかになります。分析の質問はしばしば複数のモデル呼び出しを引き起こします。毎日何千人ものユーザーがダッシュボードとやり取りしているため、AIトークンのコストは急速に増加し始めます。

AIトークンの利用が組み込み型分析ツールでどのように拡大するか

組み込み分析環境はAIシステムにとって独特のスケーリング課題をもたらします。社内分析ツールとは異なり、組み込み分析は複数のテナント、ユーザー、ワークフローを同時にまたがって動作します。

質問をする、ダッシュボードの生成、洞察の探索など、各ユーザーのやり取りはモデル全体の活動に寄与します。普及が進むにつれて、トークン消費は以下の範囲で複合的になります:

- 入居者

- ユーザー

- ダッシュボード

- 自動化されたワークフロー

これにより、AI使用コストが予想以上に速く増加するマルチプライヤー効果が生まれます。

SaaSプラットフォームにとって、AIトークンコストは単なるリクエストごとの問題ではありません。それは製品の利用や成長に直接結びついたアーキテクチャ上の考慮事項となります。

なぜCIOが関与しているのか

アプリ内組み込み分析が急増しています。近代化に消極的だったSaaSプラットフォームは、分析層が苦戦しています。この遅いBIの問題は製品への信頼を損ない、チームをAI強化分析体験へと押し進めました。

AI強化された組み込み分析は急速に人気のあるアプリ近代化戦略となりました。自然言語クエリや自動インサイトにより、質問と回答の間の時間差が短縮されます。

その大きな改善にはトレードオフがありました。より速い洞察を得るには、しばしば裏で複数のモデル操作が必要です。

シフトは新たな制約をもたらします。ダッシュボードを待つ代わりに、組織はAIインフラのコストを管理できるようになりました。単一の埋め込み分析リクエストで複数のモデルタスクをトリガーできます。これらのタスクは、やり取りのたびに増加するLLMトークンの使用を生み出します。ユーザー行動がインフラコストを左右しています。ユーザーはダッシュボードや分析アシスタントを通じて無制限に質問することができます。各相互作用はモデルの活動を増加させます。

77%のテックリーダーがAI利用拡大を計画していることから、トークン消費は今後も増加し続けるでしょう。だからこそCIOが関わっているのです。AI強化された組み込み分析はもはや単なる工学的問題ではありません。予算の問題でもあります。

マルチテナントSaaSチャレンジ

一度AI分析が組み込まれれば、製品の一部となり、利用は急速に拡大します。初期段階では、数名のクライアントが機能を試し、いくつか質問をし、トークンの消費を予算内に収めます。その時期は長くは続きません。

導入が広まるにつれて、テナントは分析を日常のワークフローに組み込んでいます。ホワイトラベル分析は製品にネイティブに組み込まれており、ユーザーはそれを常に操作しています。

AIの活動は複数の層を同時にスケールし始めます:

- テナントがダッシュボードやレポートを探索

- ユーザーが自然言語で質問する

- AIが自動的にダッシュボードを生成する

- バックグラウンドで自動で稼働するインサイト

これがSaaS製品の成功の姿です。ユーザーは深く関わります。交流が成長し、価値が複利的に積み重なります。だからこそ、チームはスケーラブルな分析アーキテクチャを中心にインフラを設計します。プラットフォームは、アプリケーション体験を遅くすることなく、増加するワークロードをサポートしなければなりません。

AIは異なるスケーリングファクターを導入します。すべての相互作用はモデル処理も生成します。単一テナント展開とは異なり、マルチテナント組み込み分析では、どのテナントでもユーザーの活動が一度でも急増すると、共有LLM使用コストに即座に影響します。その結果、テナント、ユーザー、ワークフロー全体でLLMトークン消費が急増しています。マルチテナントSaaS環境では、LLMの使用コストは直線的に増加しません。採用が広がるにつれて、その影響は増えていきます。

責任あるAI分析とはどのようなものか

AIを分析ワークフローに組み込むチームは、AIトークンコストが制御不能に膨れ上がるのを防ぐためのガードレールを計画しなければなりません。これらのガードレールは、ユーザー、テナント、ワークフローがAI機能とどのように相互作用するかを定義します。

チームに必要なコントロール:

- テナントごとのトークン制限

- ユーザーごとのリクエスト制限

- AIリクエストのスロットリング

- 分析相互作用の監視

これらのコントロールは、採用が進むにつれて長期的なAIトークン最適化を支援します。

制御されていないAI分析と、制御されたAI組み込み分析の違いは非常に重要です。

| 制御されていないAI分析 | ガバナンドAI分析 |

|---|---|

| 無制限のAIリクエスト | トークンガードレール |

| 単一モデル依存性 | モデルの柔軟性 |

| 使用状況の監視はありません | AI利用の可視性 |

| 予測不能なコスト増加 | 構造化AIトークン最適化 |

モデルの柔軟性も重要な役割を果たします。モデルによって速度、精度、トークン消費量は異なります。組織は各モデルがトークン消費にどのような影響を与えるかを理解するために評価しなければなりません。

これらの機能はSaaSプラットフォームにとって不可欠になりつつあります。チームは、利用状況を監視し、リクエストを制御し、AI使用コストを予測可能に保つ組み込みの分析アーキテクチャを必要としています。

Reveal AI問題の解決方法

無秩序なAI分析はコスト問題が起こるのを待っています。Revealはそれを防ぐために作られました。

RevealのAI搭載の組み込み分析はコストガバナンスを念頭に置いて設計されており、後付けではありません。このプラットフォームにより、チームはAI能力の運用方法を分析ワークフロー内で制御できます。これらのコントロールは、導入拡大に伴い組織が使用を管理するのに役立ちます。

Revealで得られるものは以下の通りです:

- テナントとユーザーをまたぐトークンガードレール

- 分析ワークフロー全体でのAI活動のモニタリング

- 設定可能なモデル選択と展開

- AIの相互作用に対する中央集権的ガバナンス

これらの機能は、SaaS製品全体でのAI導入拡大に伴い、チームが予測可能なAIトークンコストを維持するのに役立ちます。

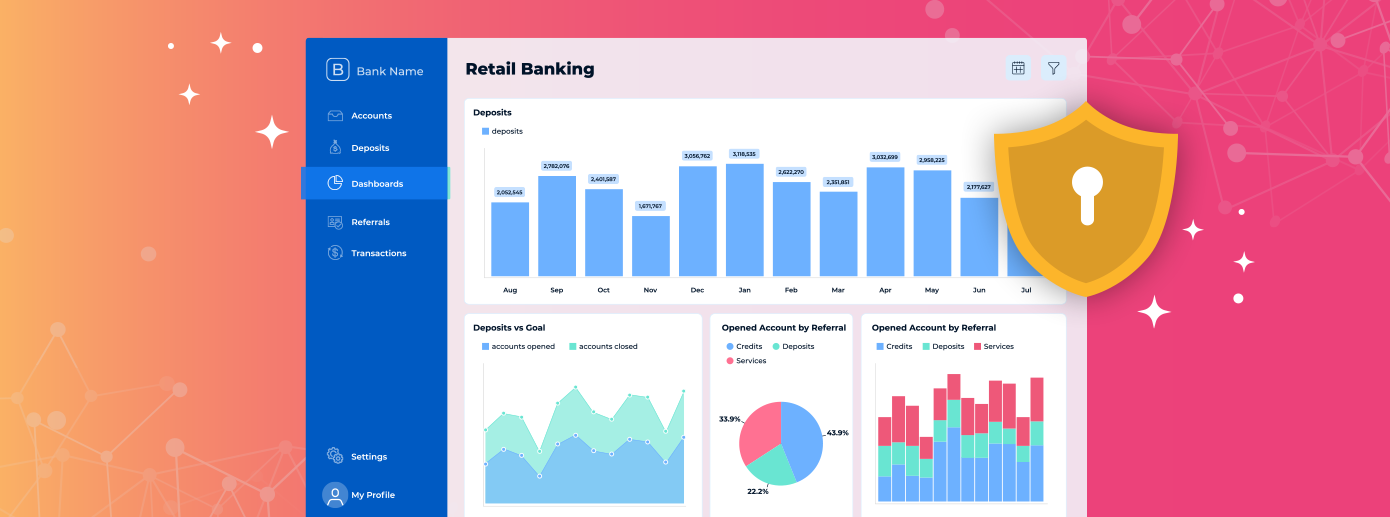

Reveal AIインフラを完全にコントロールできます:

- 既存の権限モデルを尊重する強力な分析セキュリティ

- オンプレミスの分析環境を含む柔軟な展開オプション

- モデル、プロンプト、使用ルールを含むAI分析インフラを完全にコントロールできます

- テナントやユーザー間のAI活動の可視化が組み込まれています

このアーキテクチャにより、コスト、インフラ、ガバナンスを制御しつつAI分析を拡張できます。AIがコアプロダクトとなる中で、AIトークンコストの管理は持続可能なAI分析のために不可欠となります。

関連記事

ブログに戻る

ブログに戻る